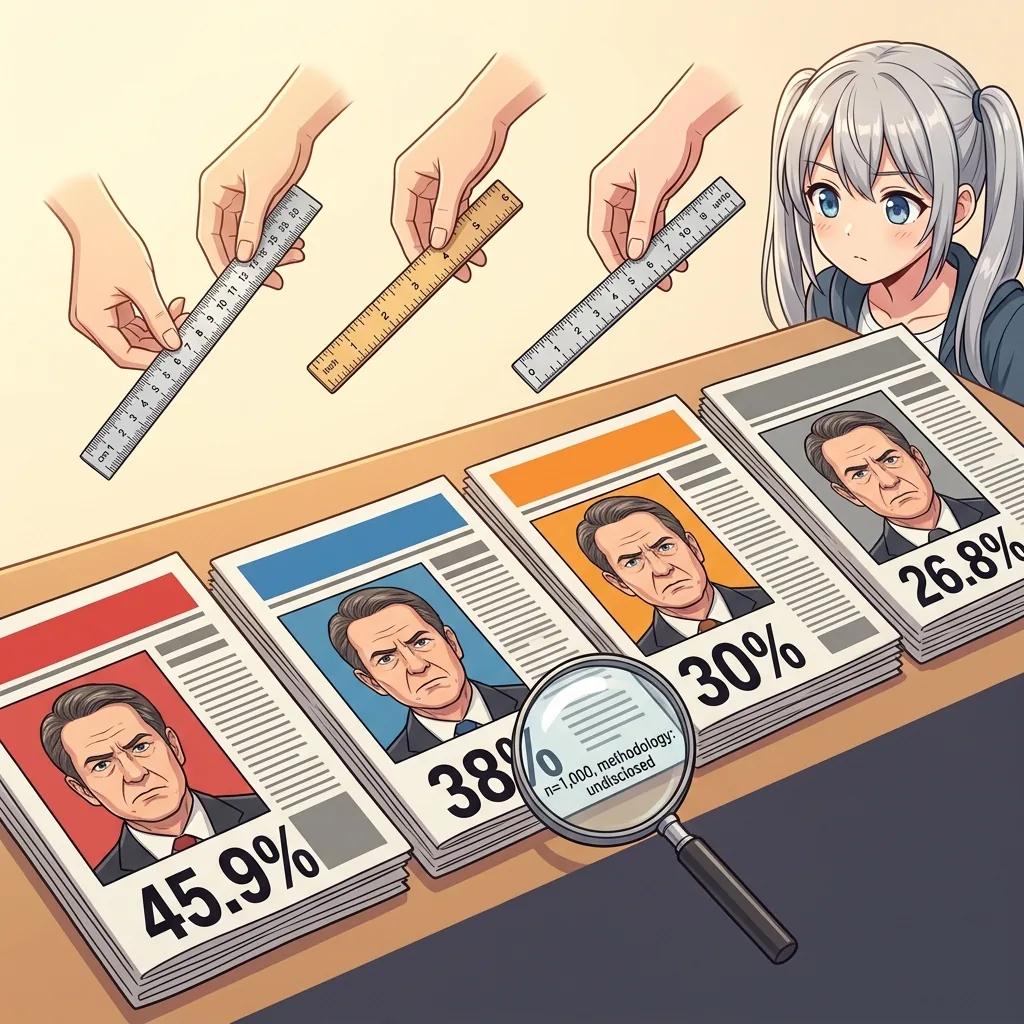

ニュースの概要

日本の主要メディアが実施する世論調査では、同じ内閣の支持率が調査元によって最大19.1ポイント差で報じられている(2024年12月・石破内閣:産経45.9% vs 時事26.8%)。方法論の違い(RDD方式・回収率・設問設計)がこの差を生んでいるが、大半の報道ではこうした背景情報が省略される。欧米ではAAPOR(米)やBPC(英)といった第三者監視機関が調査品質を担保する仕組みがあるが、日本には同等の制度が存在しない。

独自ファクトチェック・検証視点

石破内閣支持率の社別データはNippon.comの集計に基づく。FNN/産経のデータ捏造事件(2020年)の数値は東京新聞・NewsOnJapanの報道による(14回・12.9%の架空回答)。回収率の推移はJ-STAGEの朝日新聞・斎藤泰之論文および各社公開データに基づく。AAPOR・BPCの基準はそれぞれの公式サイトから直接確認。信頼度スコアはthe NTM独自の評価基準であり、特定の調査機関を攻撃する意図はない。方法論の透明性が改善されればスコアは見直す。

2024年12月、石破内閣の支持率が一斉に報じられた。

産経新聞:45.9%。 時事通信:26.8%。

同じ内閣を、同じ月に測って、19.1ポイントの差。

これは誤差ではない。方法論の違いだ。そして、この違いが読者に説明されることは、ほぼない。

「19ポイントも違うんか!? 同じ内閣じゃろ? どっちかが嘘ついとるってことじゃないの?」

「嘘ではないのよ、どちらも。ただし『同じものを測っている』という前提が間違い。時事通信は調査員が自宅を訪問して対面で聞いてる。産経は電話。対面で『支持しますか?』と聞かれたら、目の前の人間に『しません』って言いにくいでしょう? 電話のほうが本音が出やすい——でも電話に出ない人がそもそも偏ってる。測り方が違えば数字が変わるのは当然なの。」

なぜ同じ内閣で19ポイント差が出るのか

「ちょっと待って。そもそもRDDとかデュアルフレームとか、何語じゃ? わしみたいな素人にもわかるように言ってくれんか。」

「RDDは『ランダムに電話番号を作ってかける方式』。電話帳に載ってない番号にもかかるから、特定の人に偏りにくい。デュアルフレームは『固定電話と携帯の両方にかける』こと。固定電話だけだと高齢者に偏るから、携帯も混ぜて年齢層のバランスを取る仕組みよ。」

日本の主要メディアは、2016年以降このRDD+デュアルフレーム方式にほぼ統一されている。一見同じ方法に見えるが、それでも差が出る。ポイントは3つある。

①回収率の差——「電話に出ない人」の問題

電話をかけても出ない人がいる。その「出ない人」がどれくらいいるかで、結果が変わる。

2024年4月時点の回収率:

| 社 | 固定電話 | 携帯電話 |

|---|---|---|

| 読売新聞 | 61% | 37% |

| 朝日新聞 | 50% | 39% |

| 日経新聞 | 40.1%(全体) | |

| 時事通信 | 対面個別面接(RDDではない) | |

回収率61%の読売と40%の日経では、「答えなかった人」の割合が全然違う。答えない人ほど不満層が多い傾向があり、回収率が低い調査ほど支持率が高く出やすい。

②設問設計の差

憲法改正に関する世論調査で、朝日新聞は「国会で改憲論議を始めるべきか」と聞いて55%が賛成。読売新聞は「今後の国会で改憲議論を活発にすべきか」と聞いて70%が賛成。同じテーマで15ポイント差。

「始めるべきか」と聞くのと「活発にすべきか」と聞くのでは、心理的ハードルが違う。こうした設問設計のニュアンスが結果を左右するが、設問の全文が公開されることは稀だ。

③調査タイミングの差

NHKと通信社は毎月10〜13日に実施、日経は24〜26日、他の新聞社は17〜19日。同じ月でも、ニュースの流れによって支持率は変動する。不祥事が月の前半に出れば、前半に調査した社だけ数字が下がる。

「回収率、設問、タイミング。全部違うのに同じ『支持率』って見出しで並ぶ。読者は高い方と低い方の平均を取って『まあこんなもんか』と思う。それ、どの社の数字とも違う架空の数字だ。」

日本には「調査の番人」がいない

米国にはAAPOR(American Association for Public Opinion Research)のTransparency Initiativeがあり、PewやGallupが加盟。調査方法・設問文・回収率・誤差範囲の全公開を義務づけている。

英国にはBPC(British Polling Council)があり、投票意向調査には「過去の選挙における世論調査の実績に基づき、政党支持率の真の値が推定値の4ポイント以内に収まる確率は10回中9回です」という注記を義務づけている。

日本は?

JMRA(日本マーケティング・リサーチ協会)がISO 20252準拠の品質基準を定めているが、これはマーケティングリサーチ向け。メディアの政治世論調査を対象とする独立監視機関は存在しない。

| 項目 | 🇺🇸 米国 | 🇬🇧 英国 | 🇯🇵 日本 |

|---|---|---|---|

| 調査実施者 | 第三者機関(Gallup, Pew) | 第三者機関(YouGov, Ipsos) | 自社メディア |

| 監視機関 | AAPOR | BPC | なし |

| 方法論開示義務 | 任意だが追跡される | 24時間以内に公開 | 義務なし |

| 調査機関格付け | FiveThirtyEight(A+〜F) | BPC苦情処理制度 | 存在しない |

| 外部品質チェック | 第三者分離が担保 | 第三者分離が担保 | 自社検証のみ |

つまり日本では、メディアが自分で調査して、自分で報じて、自分で検証している。審判と選手が同じ人間だ。

「不正」は起きるのか——産経/FNNの前例

2020年、FNN(フジテレビ系列)と産経新聞の合同世論調査で、下請け企業の社員がデータを捏造していたことが発覚した。

14回分の調査、計1,886件の架空回答。全体の12.9%が存在しない人の声だった。

原因は「電話をかけるスタッフが足りなかった」。つまりコスト削減のために数字を作った。

「1割以上がウソじゃったんか……。じゃが逆に考えると、バレたのはここだけじゃろ? 他の社も下請けに丸投げしとったら、同じことが起きてないって誰が保証するんじゃ?」

「誰も保証できないの。それが構造的な問題。アメリカではFiveThirtyEightが調査機関をA+〜Fで格付けしてて、過去の予測精度と実際の選挙結果を突き合わせて検証してる。日本にはそれがない。メディアが自分で調査して、自分で報じて、自分で『正確です』と言う。審判がプレイヤーを兼ねてる状態よ。」

n=1,000 は「統計的に有効」か

「ニュースでよく『1,000人に聞きました』って言うじゃろ。日本の人口1億2000万なのに、たった1,000人で全体がわかるもんなんか?」

「実はわかるの。統計学の面白いところでね。味噌汁の味見をするとき、鍋全部飲まなくても一口でわかるでしょう? よくかき混ぜてあれば。n=1,000で誤差は±3.1%。ただし——ここが肝心——『よくかき混ぜてある』場合だけ。つまりランダムに選ばれた1,000人なら有効だけど、手を挙げた1,000人だと話が全然変わるのよ。」

数学的には、n=1,000のランダム抽出調査は誤差±3.1%(95%信頼区間)だ。つまり「支持率40%」と出たら、真の値は36.9%〜43.1%の間にある確率が95%。これ自体は統計学的に十分なサイズだ。

ただし、これは「ランダムに選ばれた1,000人」の場合に限る。

オンラインパネル調査(GMO Research、マクロミル等)は「手を挙げた人」の集まりだ。「アンケートに答えます」と自分から登録した人だけが対象。暇な人、ポイントが欲しい人、意見を言いたい人に偏る。この場合、n=10,000でも誤差の計算式が使えない。

| サンプルサイズ | 誤差(95%CI) | 条件 |

|---|---|---|

| n=100 | ±9.8% | 確率抽出の場合 |

| n=500 | ±4.4% | 確率抽出の場合 |

| n=1,000 | ±3.1% | 確率抽出の場合 |

| n=10,000 | ±1.0% | 確率抽出の場合 |

| n=10,000 | 計算不能 | オンラインパネル(非確率抽出) |

サンプルを4倍にしても誤差は半分にしかならない。そして非確率抽出では、そもそも誤差の議論自体が無効。

Gallupは明確に警告している——オンラインパネルのデータは「回答者の不注意、不正直な回答、重複回答」のリスクを含み、オプトイン方式のサンプルを「オンラインの代表的サンプル」と記述するだけでは透明性の基準を満たさない、と。

「味噌汁の例えわかりやすいのう! じゃあオンラインアンケートは……味噌汁の上澄みだけ飲んで『薄い』って言っとるようなもんか。」

「うまいこと言う。しかもその上澄みを『1万人に聞きました』って出すから余計にタチが悪い。数が多ければ正しく見えるのが人間の弱点だ。」

the NTM 調査信頼度ランキング

ここまでの分析を踏まえて、the NTMは独自の調査信頼度スコアを策定した。5つの軸で各20点、合計100点で評価する。

評価5軸:

- 調査主体の独立性(資金源と実施者の分離)

- 方法論の開示度(設問文・サンプリング・回収率の公開)

- サンプリングの質(確率抽出 vs 非確率抽出)

- 再現可能性(ローデータ・設問票への第三者アクセス)

- 監査体制(第三者チェック・業界基準準拠)

確率抽出・方法論全公開・第三者監査あり

方法論開示あり。自己申告ベースだが日米独比較は有用

RDD+デュアルフレーム。公共放送だが自社実施・外部監査なし

RDD採用だが設問全文非公開。産経/FNNは2020年捏造事件の前例あり

オンラインパネル(非確率抽出)。設問票は非公開が多い

方法論不明。n数・期間・設問が非公開。結論の数字だけが見出しに

自戒——the NTMも使っている

ここで正直に告白する。

前回の記事「なぜMicrosoftは「AI後進国」日本に1.6兆円を賭けるのか」で、the NTMはGMO Researchの調査(D評価・38点)を引用した。「AI利用率42.5%」という数字だ。

この数字が嘘だと言いたいわけではない。ただ、n=1,108のオンラインパネル調査であること、設問の全文が公開されていないこと、サンプリングが非確率抽出であることを記事中で十分に注記していなかった。

メディアの数字を批判するなら、自分たちの数字の使い方も検証しなければフェアではない。

今後the NTMでは、記事中で調査データを引用する際に信頼度ランクを明示する方針を採る。

「自分で使っといて自分にダメ出しするんか! 正直すぎるじゃろw でもなんか、そういうメディア他にないから逆に信用できるかもしれんのう。」

「the NTMもGoogleのアルゴリズムに依存して、読まれるタイトルの誘惑と戦いながら記事を書いてる。批判する側と同じ構造の中にいる。その自覚なしにメディアを叩いたら、ただの高みからの石投げよ。だから自分の傷から見せる。」

では、読者はどうすればいいのか

完璧な調査は存在しない。しかし、数字の見方は改善できる。

3つの実践ルール:

- 「誰が・どうやって」を確認する:記事中にn数・調査方法・期間が書いてなければ、その数字は検証不能。鵜呑みにしない

- 複数のソースが同じ方向を指しているかを見る:1社の調査だけで結論を出さない。3つ以上の独立した調査が同じ傾向を示していれば、方向性は信頼できる

- 「〇〇%が支持」ではなく「〇〇%が支持(〇〇調査、n=〇〇、RDD方式)」で読む:括弧の中身が書いてない数字は、括弧の中身を想像するまで判断を保留する

「調査を信じるな、とは言わない。『誰が、何人に、どうやって聞いたか』を確認しろ。それが書いてなかったら、その数字は鵜呑みにするな。3秒で済む習慣だ。それだけでニュースの見え方が変わる。」

「数字の読み方」シリーズ:

- 本記事が第1弾です。評価基準の詳細は調査信頼度インデックスをご覧ください。

- Nippon.com: 石破内閣支持率データ

- J-STAGE: RDD世論調査の方法論

- AAPOR Transparency Initiative

- British Polling Council 開示規則

- NewsOnJapan: FNN/産経 世論調査不正

参考文献・検証ログ

Score Breakdown

100点。参照が揃っていて、公開後の更新も追いやすい状態です。

調べる

参照 5 本。一次情報 4 本 / 二次情報 1 本を当てて、本文の芯を固める。

確かめる

100pt で監査を通し、2026-04-12 10:00 JST に公開できる形へ整える。

残す

公開 0 回。更新の入口を開けておいて、あとから辿れるようにする。

この経過表示は publish_audit.jsonl と記事の監査メタをもとに、 ビルド時にまとめて描画しています。更新は再デプロイで反映されます。

更新・訂正履歴

更新履歴

- 2026-04-12: 初稿公開。

訂正履歴

- 現時点で訂正はありません。